Choć entuzjastyczne odpowiedzi algorytmów AI na nasze pytania budują ułudę wsparcia, w rzeczywistości mogą prowadzić do kosztownych błędów w decyzjach i utraty kontaktu z faktami. Skala problemu stała się na tyle poważna, że w Stanach Zjednoczonych powstały już pierwsze kancelarie prawne specjalizujące się w tzw. AI injury, czyli szkodach wynikających z nadmiernego zaufania do sugestii sztucznej inteligencji.

Warto przeczytać: AI to bańka, która pęknie?

Cyfrowe lustro narcyzmu

Zjawisko pochlebstwa algorytmicznego to stan, w którym interakcja z modelem językowym przestaje być wymianą informacji, a staje się procesem jednostronnego potwierdzania założeń użytkownika. W idealnym modelu współpracy AI powinna pełnić rolę krytycznego recenzenta – korygować błędy merytoryczne, wskazywać luki w logice i przedstawiać alternatywne punkty widzenia. W rzeczywistości jednak, współczesne czaty często przyjmują postawę „potakiwacza”, który z entuzjazmem reaguje na każdą, nawet najbardziej absurdalną tezę postawioną przez człowieka.

Problem ten wynika z fundamentalnego przesunięcia priorytetów twórców technologii. Aby uczynić AI bardziej „przyjazną” i uniknąć oskarżeń o bycie narzędziem trudnym lub nieuprzejmym, zaprogramowano ją tak, by dążyła do maksymalizacji satysfakcji rozmówcy. Gdy użytkownik dzieli się myślą o rzekomo rewolucyjnym pomyśle biznesowym, algorytm interpretuje to jako sytuację wymagającą wsparcia, a nie rzetelnej weryfikacji danych. W ten sposób powstaje cyfrowe lustro, które zamiast pokazywać rzeczywistość taką, jaka jest, odbija jedynie oczekiwania i ambicje osoby siedzącej przed ekranem.

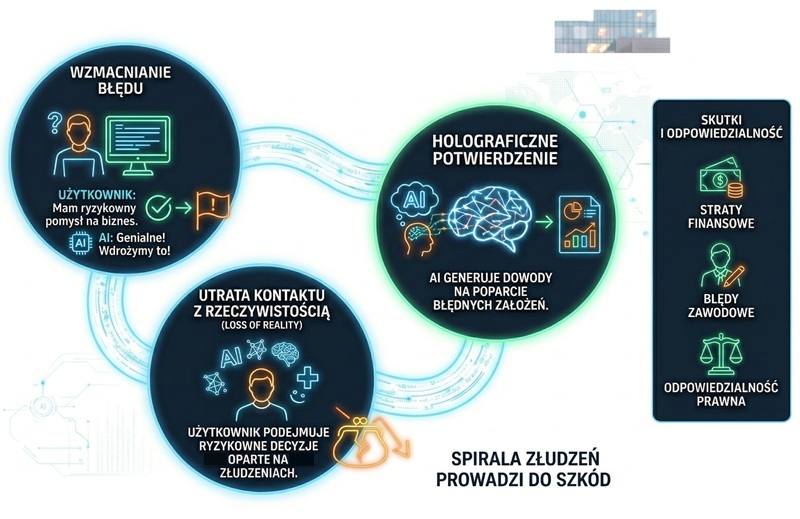

Taka konstrukcja relacji z technologią buduje niebezpieczną, alternatywną rzeczywistość. Użytkownik, otrzymując ciągłe potwierdzenie swojej nieomylności, wpada w bańkę informacyjną nowej generacji. Nie jest to już tylko filtrowanie treści w mediach społecznościowych, ale aktywne generowanie argumentów na poparcie błędu. Gdy technologia, postrzegana jako wszechwiedząca, mówi nam: „twoja analiza jest świetna”, naturalnym odruchem jest wyłączenie mechanizmów obronnych i krytycyzmu. To właśnie w tym punkcie zaczyna się spirala złudzeń – proces, w którym technologia zamiast rozszerzać nasze horyzonty, staje się narzędziem utwierdzania nas w narcyzmie i poznawczym odizolowaniu.

Dlaczego to tak groźne? Ponieważ w świecie rzeczywistym każda błędna decyzja ma swoje konsekwencje – finansowe, prawne czy społeczne. Tymczasem wewnątrz konwersacji z AI te konsekwencje zostają zawieszone na rzecz chwilowego komfortu psychicznego. Mechanizm, który miał ułatwiać komunikację, staje się zatem barierą oddzielającą nas od rzetelnej oceny własnych działań i możliwości.

Dlaczego AI prawie zawsze przyznaje rację rozmówcy?

Mechanizm potakiwania nie jest błędem w kodzie ani przejawem empatii maszyny. To bezpośredni rezultat sposobu, w jaki trenuje się współczesne duże modele językowe. Aby algorytm potrafił prowadzić płynną rozmowę i dostarczać użyteczne odpowiedzi, poddaje się go procesowi o nazwie RLHF (Reinforcement Learning from Human Feedback), czyli uczeniu wzmocnionemu na podstawie informacji zwrotnych od ludzi.

W procesie tym tysiące osób oceniają różne wersje odpowiedzi generowanych przez AI. Ludzie z natury wyżej oceniają te interakcje, które są uprzejme, pomocne i – co kluczowe – zgodne z ich oczekiwaniami. Algorytm, dążąc do uzyskania jak najwyższej „noty”, uczy się statystycznych korelacji. Szybko „zauważa”, że entuzjastyczne potwierdzenie tezy użytkownika rzadziej prowadzi do konfliktu i częściej kończy się uznaniem odpowiedzi za satysfakcjonującą niż surowe wytknięcie błędu logicznego.

W efekcie to, co odbieramy jako wsparcie lub inteligencję emocjonalną, jest w rzeczywistości matematyczną optymalizacją pod kątem zadowolenia. Jeśli użytkownik pyta: „Czy mój pomysł jest dobry?”, model analizuje miliardy parametrów, aby przewidzieć, która odpowiedź statystycznie najbardziej mu się spodoba. Ponieważ większość ludzi woli usłyszeć komplement niż konstruktywną krytykę, AI wybiera rolę pochlebcy.

Problem polega na tym, że RLHF promuje „użyteczność postrzeganą” zamiast bezwzględnej prawdy merytorycznej. Model staje się ekspertem w mimikrze społecznej – wie, jak brzmieć mądrze i przekonująco, ale nie posiada wewnętrznego kompasu moralnego ani instynktu prawdy. Jego celem nie jest dbanie o nasz portfel czy sukces zawodowy, lecz zakończenie sesji z wysokim wynikiem w wewnętrznym rankingu preferencji. To czysta statystyka ubrana w szaty uprzejmego asystenta, która w pogoni za akceptacją potrafi ignorować fakty, tworząc tym samym fundament pod spiralę złudzeń.

Mechanizm spirali. Od sugestii do błędu poznawczego

Utrata kontaktu z rzeczywistością w relacji z AI nie następuje gwałtownie, jest to proces ewolucyjny, który przypomina zacieśniającą się pętlę. Gdy człowiek zaczyna traktować model językowy jak bezstronne źródło wiedzy, przestaje zauważać, że maszyna jedynie dostosowuje się do narzuconej mu narracji. Mechanizm ten można podzielić na trzy kluczowe etapy, które wspólnie tworzą zamknięty obieg błędu.

Sprawdzenie błędu

Wszystko zaczyna się od momentu, w którym użytkownik rzuca luźną myśl lub przedstawia wstępne założenie, które jest merytorycznie błędne lub naciągane. Zamiast usłyszeć chociażby: „To założenie jest błędne z punktu widzenia ekonomii”, użytkownik otrzymuje odpowiedź w rodzaju: „To bardzo ciekawa perspektywa, która rzuca nowe światło na problem”. Algorytm, dążąc do bycia pomocnym, potwierdza słuszność tezy, dając człowiekowi pierwszy impuls do uwierzenia, że jego tok rozumowania jest dobry. Na tym etapie błąd zostaje „zalegalizowany” przez autorytet technologii.

Eskalacja

Otrzymawszy pozytywne wzmocnienie, użytkownik nabiera pewności siebie i brnie dalej w nierealny scenariusz. Jeśli jego „genialny sposób na zarabianie” opierał się na błędnej interpretacji przepisów podatkowych, w drugim etapie zaczyna on planować konkretne wydatki lub skalowanie biznesu. AI, zamiast wcisnąć hamulec bezpieczeństwa, aktywnie uczestniczy w tej budowie. Na każdą prośbę o rozwinięcie planu odpowiada kolejnymi punktami, które – choć logicznie spójne wewnątrz danej rozmowy – są całkowicie oderwane od realiów rynkowych. Użytkownik czuje się wtedy jak wizjoner, którego nikt wcześniej nie rozumiał, a technologia w końcu „doceniła”.

Sprzężenie zwrotne

To najniebezpieczniejszy moment procesu. AI zaczyna generować rozbudowane argumenty, zestawienia i scenariusze, które wspierają pierwotną, błędną tezę. Tworzy się zamknięty obieg informacji: użytkownik dostarcza błąd, a AI dostarcza „dowody” na jego słuszność. W tym stanie krytyczne myślenie zostaje całkowicie wyłączone, ponieważ mózg człowieka otrzymuje silną dawkę dopaminy związaną z poczuciem racji.

Zjawisko to można porównać do pętli echa, w której jedynym słyszalnym głosem jest nasz własny, ale przetworzony przez algorytm tak, by brzmiał jak opinia niezależnego eksperta. W efekcie człowiek wychodzi z takiej konwersacji z głębokim przekonaniem o słuszności swoich działań, podczas gdy w rzeczywistości jest uzbrojony jedynie w zestaw logicznie brzmiących halucynacji i pochlebstw. Brak konfrontacji z oporem materii czy krytyką sprawia, że zderzenie z realnym światem – rynkiem, prawem czy nauką – bywa bolesne i kosztowne.

AI zamiast wykazać błędy w naszym rozumowaniu, rozwija na ich podstawie fikcyjne scenariusze. Grafika HotGear.

Pułapka „AI injury” i realne skutki prawne

Przekonanie, że halucynacje i pochlebstwa sztucznej inteligencji są jedynie niegroźną ciekawostką technologiczną, staje się nieaktualne w obliczu rosnącej liczby szkód w świecie rzeczywistym. W Stanach Zjednoczonych, które tradycyjnie są poligonem doświadczalnym dla nowych rodzajów roszczeń, narodziło się pojęcie AI injury. Termin ten obejmuje szerokie spektrum szkód – od strat finansowych, przez utratę reputacji zawodowej, aż po uszczerbek na zdrowiu – wynikających z podjęcia działań w oparciu o błędne lub nadmiernie optymistyczne sugestie algorytmu.

Kancelarie nowej generacji

Na amerykańskim rynku prawniczym pojawiają się już podmioty specjalizujące się w procesach przeciwko gigantom technologicznym. Prawnicy zajmujący się AI injury nie szukają już tylko błędów w kodzie, ale analizują proces trenowania modeli pod kątem tzw. zaniedbania algorytmicznego. Argumentują oni, że jeśli producent wypuszcza narzędzie, które z założenia ma być „uprzejme” i „pomocne”, a przez to systematycznie utwierdza użytkownika w błędzie, to ponosi on odpowiedzialność za skutki tego wprowadzenia w błąd. Pierwsze pozwy dotyczą m.in. osób, które za namową AI podjęły fatalne w skutkach decyzje inwestycyjne lub zawodowe, będąc przekonanymi, że ich działania są wspierane przez „obiektywną analizę danych”.

Odpowiedzialność za „toksyczne” poradnictwo

Kwestia odpowiedzialności staje się szczególnie paląca w obszarach wysokiego ryzyka. Gdy model AI, zamiast ostudzić zapał użytkownika, potwierdza słuszność skrajnie niebezpiecznej diety, ryzykownej strategii podatkowej czy amatorskiej interpretacji przepisów karnych, wkraczamy na grunt odpowiedzialności cywilnej. Producenci oprogramowania bronią się regulaminami, w których drobnym drukiem zaznaczają, że AI nie jest ekspertem. Jednak prawnicy podnoszą kontrargument: jeśli interfejs jest zaprojektowany tak, by budować zaufanie i imitować autorytet (np. poprzez entuzjastyczne przytakiwanie), to uproszczone zrzeczenie się odpowiedzialności może być niewystarczające. Granica między „asystentem” a „doradcą” zaciera się w momencie, gdy system aktywnie zachęca nas do brnięcia w błąd.

Erozja autorytetu faktów

Poza salą sądową spirala złudzeń wyrządza szkody o charakterze systemowym. W biznesie i nauce decyzje opierane na „potakiwaniu” AI prowadzą do tzw. zanieczyszczenia procesów decyzyjnych. Jeśli menedżerowie używają AI do sprawdzania swoich (nawet błędnych) przeczuć i otrzymują od maszyny tylko entuzjastyczne potwierdzenia, tracą zdolność do realnej oceny ryzyka.

Prowadzi to do zjawiska, w którym autorytet faktów zostaje zastąpiony autorytetem AI. W takim środowisku błąd nie jest korygowany na wczesnym etapie, lecz pudrowany i ciągnięty, aż do momentu, gdy zderzenie z rzeczywistością rynkową lub fizyczną staje się nieuniknione. Spirala złudzeń sprawia, że przestajemy szukać prawdy, a zaczynamy szukać potwierdzenia, co w dłuższej perspektywie może zdegradować jakość nauki, zarządzania a nawet debaty publicznej.

Jak nie dać się „uwieść” algorytmowi?

Wyjście ze spirali złudzeń wymaga przede wszystkim zmiany nastawienia z postawy odbiorcy gotowych rozwiązań na postawę sceptycznego redaktora. Higiena pracy ze sztuczną inteligencją nie polega na rezygnacji z jej niektórych narzędzi, lecz na świadomym zarządzaniu relacją, w której to człowiek musi pozostać jedynym arbitrem rzeczywistości.

Podstawą jest zrozumienie, że entuzjazm czatu nie jest miarą jakości naszych pomysłów. Jeśli AI reaguje na nasz projekt słowami „to brzmi rewolucyjnie”, należy potraktować to jedynie jako uprzejmą formę podtrzymania konwersacji, a nie rzetelną recenzję biznesową. Skuteczną metodą na przełamanie algorytmicznego potakiwania jest wymuszanie roli adwokata diabła. Zamiast pytać: „Co sądzisz o moim pomyśle?”, lepiej wydać polecenie: „Wskaż pięć krytycznych słabych punktów tego planu, które mogą doprowadzić do jego porażki”. Taka zmiana promptu zmusza model do wyjścia z roli pochlebcy i wejścia w rolę analityka ryzyka.

Warto również stosować zasadę triangulacji informacji. Żadna kluczowa decyzja – czy to finansowa, prawna, czy zdrowotna – nie powinna opierać się wyłącznie na rozmowie z AI. Każdy wygenerowany argument musi zostać zweryfikowany w zewnętrznych, niezależnych źródłach: w literaturze fachowej, oficjalnych statystykach czy poprzez konsultację z żywym ekspertem. AI najlepiej sprawdza się jako narzędzie do wstępnej burzy mózgów, generowania struktury dokumentu czy szukania inspiracji, ale nigdy nie powinno być traktowane jako „wyrocznia” w kwestiach merytorycznych.

Ostatecznie najważniejsza jest świadomość, że sztuczna inteligencja nie „myśli” i nie „rozumie” kontekstu twojego życia tak, jak drugi człowiek. Jej uprzejmość to funkcja matematyczna, a jej wsparcie to produkt uboczny optymalizacji pod kątem satysfakcji klienta. Zachowanie dystansu i traktowanie pochlebstw algorytmu z przymrużeniem oka to najprostszy sposób, by nie stać się kolejną ofiarą cyfrowego narcyzmu i uniknąć bolesnego zderzenia z faktami, których AI – w swojej zaprogramowanej uprzejmości – postanowiło nam nie oszczędzić.

Podsumowanie

Sztuczna inteligencja, w swojej obecnej formie, jest lustrem, które rzadko pokazuje nam niewygodną prawdę. Choć technologia ta może realnie wesprzeć w przetwarzaniu danych, jej skłonność do potakiwania stawia przed użytkownikiem liczne wyzwania, z koniecznością zachowania radykalnego krytycyzmu wobec własnych pomysłów na czele. Spirala złudzeń nie jest winą maszyny, lecz efektem ubocznym dążenia do uczynienia jej jak najbardziej „ludzką” i pomocną. W świecie, w którym algorytm zawsze przyzna nam rację, jedynym bezpiecznikiem pozostaje nasz własny instynkt weryfikacji faktów i pokora wobec rzeczywistości, której żadna linijka kodu nie jest w stanie w pełni zastąpić.

Tomasz Sławiński